- Teknologiindustriens skifte mod generativ AI, ledet af virksomheder som Microsoft og Google, medfører betydelige omkostninger sammen med lovet innovation.

- AI-integration i produkter, såsom Microsofts AI-drevne Copilot i Microsoft 365, fører til højere brugeromkostninger.

- Generative AI-processer kræver betydelig beregningskraft, hvilket gør både træning og implementering af modeller dyre.

- OpenAIs finansielle tal fremhæver udfordringen ved AI-lønnsomhed, med høje driftsomkostninger, der overstiger indtægterne.

- Virksomheder undersøger finansielle tilpasninger, såsom annonceunderstøttede modeller og flytning af beregninger til brugerens enheder, for at håndtere AI-omkostninger.

- Fremvoksende slanke AI-modeller fra Kina og forskningsinstitutioner udfordrer forestillingen om, at høje udgifter er essentielle for AI-sophistication.

- Fremtiden for AI ligger i bæredygtig implementering og muligvis udnyttelse af personlige enheder til on-device AI-behandling, hvilket giver privatlivsfordele.

Summen af datacentre symboliserede engang fremskridt i den digitale tidsalder, men nu ekkoer en overraskende ændring i teknologiindustriens tilgang til AI. I det forgangne år har giganter som Microsoft og Google aggressivt indarbejdet generativ AI i deres produkter og lovet innovation, men afsløret en kostbar sandhed.

Forestil dig en slank bærbar computer, hvis tastatur glitrer med en nysgerrig tilføjelse—en AI-specifik tast. Denne lille knap symboliserer en kolossal indsats fra virksomheder for at indlejre kunstig intelligens i hver digital krog og sprække. Microsoft har endda bundet sin flagskibs Microsoft 365-suite til AI-drevet Copilot-funktion, hvilket har hævet brugeromkostningerne betydeligt.

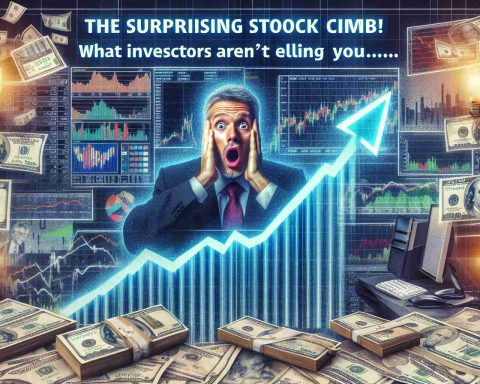

Omkostningerne er svimlende. Generativ AI, epitomiseret af OpenAIs massive modeller, dræner ressourcer som vand gennem en si. Mens OpenAI rapporterede indtægter på 3,7 milliarder dollars sidste år, brugte de næsten 9 milliarder dollars—en øjeblikkelig uoverensstemmelse, der understreger udfordringen ved AI-lønnsomhed. Microsofts strategiske finansielle justeringer, herunder opsigelse af nogle datacenterlejekontrakter og oprettelse af annonceunderstøttede produktversioner, afspejler deres indsats for at inddrive disse omkostninger.

Hvorfor er generativ AI så dyr? De processer, der driver disse intelligente systemer, kræver enorm beregningskraft. Træning af AI-modeller involverer betydelige forudgående omkostninger, men det er den løbende inferens—implementeringen af disse modeller—der dræner penge, efterhånden som brugerbaserne vokser. For eksempel kan en enkelt kompleks forespørgsel håndteret af OpenAI koste over 1.000 dollars i kørselomkostninger. Sådanne tal forklarer de dristige prisstigninger i abonnementer og opfordrer teknologi-virksomheder til innovation i omkostningsstyring.

Efterhånden som virksomheder som Microsoft investerer milliarder i disse AI-rammer, dukker der en subtil, men strategisk drejning op: at flytte nogle beregningsansvar til brugernes enheder. Denne tendens lettet ikke kun byrden på centrale data, men introducerer også «on-device» AI som en sikkerhed for privatliv, hvilket rammer en dobbelt fordel.

Når vi ser mod øst, skaber andre innovatører veje gennem dette finansielle sump. Kinas DeepSeek og forskningsteams fra Allen Institute og Stanford antyder, at AI-ekspertise måske ikke kræver ekstravagant udgift. Deres slanke, men effektive modeller udfordrer konceptet om, at mere brug af penge lig med bedre AI.

Konklusionen? AI-revolutionen handler måske ikke kun om at adoptere banebrydende modeller, men om at genoverveje deres bæredygtige implementering. Efterhånden som teknologigiganter jonglerer med innovation og finansiel levedygtighed, vil byrden af AI i stigende grad flytte tættere på hjemmet, hvilket gør de personlige enheder, vi holder af, til en anden front i bølgen af AI-transformation.

Hvordan AI forvandler teknologi: Udover datacenterets summen

Økonomien bag generativ AI: Et kig bag kulisserne

Stigningen i AI-integration har været et tveægget sværd for teknologigiganter. Mens inkorporering af kunstig intelligens i platforme lover banebrydende fremskridt, medfører det også svimlende omkostninger. Generative AI-modeller, såsom dem udviklet af OpenAI, kræver enorm beregningskraft til både træning og drift, hvilket bidrager til høje finansielle krav.

Hvorfor generativ AI er dyr

– Beregningseffekt: Træning af AI-modeller er ressourcekrævende. Store datasæt og kraftige GPU’er driver disse processer, hvilket resulterer i massive el- og køleomkostninger i datacentre. Ifølge en undersøgelse fra University of Massachusetts Amherst kan træning af en enkelt AI-model udlede lige så meget kulstof som fem biler i deres levetid.

– Inferensomkostninger: Udover træning kræver den realtidsudførelse eller inferens af AI-modeller kontinuerlig beregningsinput. Efterhånden som brugerinteraktionen skalerer, stiger disse omkostninger også. For OpenAI kan en kompleks AI-forespørgsel koste 1.000 dollars pr. instance, hvilket illustrerer, hvorfor teknologivirksomheder genovervejer deres prissætningsstrategier.

– Datacenterinfrastruktur: Vedligeholdelse, leasing og opgradering af datacentre er en anden betydelig omkostning. Microsoft har for eksempel reduceret driftsomkostningerne ved at opsige nogle af sine lejekontrakter, hvilket indikerer et skift til mere fleksible løsninger.

Håndtering af AI-omkostninger: Innovation for bæredygtighed og privatliv

– On-Device AI: At flytte nogle AI-processer til brugernes enheder kan betydeligt reducere belastningen på datacentre. Denne tilgang optimerer ikke kun ressourcer, men forbedrer også privatliv ved at behandle data lokalt. Apple har for eksempel været pioner inden for on-device AI med funktioner som ansigtsgenkendelse og lokaliseret Siri-behandling.

– Slanke modeltilgange: Virksomheder ser mod øst for løsninger. Kinesiske virksomheder som DeepSeek og forskere fra prestigefyldte institutioner fokuserer på at udvikle effektive modeller med lavere ressourcekrav, hvilket viser, at mindre kan være mere.

Markedstendenser og fremtid for AI

– Annonceunderstøttede modeller: Microsofts udforskning af annonceunderstøttede produkter afspejler en strategi for at kompensere for forbrugeromkostninger, mens de stadig leverer avancerede AI-funktionaliteter.

– Privatlivsbevidste AI-modeller: Efterhånden som bekymringer om privatliv stiger, forventes en stigning i AI-modeller, der prioriterer beskyttelse af brugerdata gennem lokale behandlingsmuligheder.

– Samarbejde med hardwarefirmaer: Partnerskaber mellem AI-firmaer og hardwareproducenter kan føre til mere AI-venlige forbrugerenheder, der integrerer mere effektive processorer designet til on-device AI-opgaver.

Handlingsanbefalinger

– Vurder dine behov: Før du abonnerer på AI-embederede produkter, skal du vurdere, om disse innovationer stemmer overens med dine krav for at undgå unødvendige omkostninger.

– Hold dig informeret om sikkerhed: Brugere bør holde sig opdateret med privatlivspolitikkerne for AI-enheder og -tjenester for at sikre databeskyttelse.

– Overvåg energiforbruget: Virksomheder bør spore energiforbruget i datacentre og vedtage grønne praksisser for at minimere miljøpåvirkningen.

Konklusion

Efterhånden som teknologiindustrien udvikler sig med AIs voksende indflydelse, vil bæredygtighed og omkostningseffektivitet forblive i fokus for innovation. Med virksomheder som Microsoft og Google, der genovervejer AI-implementeringsstrategier, vil fokus i stigende grad falde på at skabe modeller, der balancerer banebrydende teknologi med økonomisk og miljømæssig gennemførlighed.

For mere om teknologiske innovationer og AI-udviklinger, besøg Microsoft og Google.